اپ های نژاد پرست!

قطعا فناوری نمی تواند نژاد پرست باشد پس چطور یک نرم افزار یا هوش مصنوعی نژادپرست می شود؟

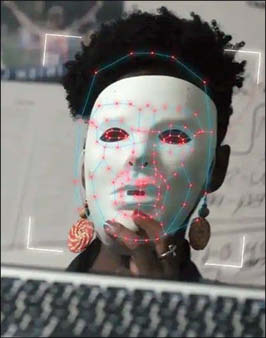

ناصری- مسئله نژادپرستی در هوش مصنوعی و اپلیکیشن های ساخته شده چند سالی هست که مطرح می شود و به نظر می رسد اولین بار زمانی که مایکروسافت یک روبات چت به نام Tay را در توئیتر منتشر کرد، مسئله نژاد پرستی در هوش مصنوعی مطرح شد. به تازگی هم در فضای مجازی یک دانشجوی دختر سیاهپوست دانشگاه MIT متوجه میشود برای تشخیص چهره توسط هوش مصنوعی زیادتر از دیگر دوستانش به مشکل میخورد و برای رفع مشکل راههای مختلفی را امتحان میکند تا درنهایت به این نتیجه می رسد که با استفاده از یک ماسک سفید مشکل اش حل میشود! این اتفاق نشان می دهد که متاسفانه نژاد پرستی در هوش مصنوعی هم رسوخ پیدا کرده است. امروز با هم مروری بر چند اپلیکیشن معروف نژاد پرست که باعث خشم بسیاری از مردم شده خواهیم داشت.

ناصری- مسئله نژادپرستی در هوش مصنوعی و اپلیکیشن های ساخته شده چند سالی هست که مطرح می شود و به نظر می رسد اولین بار زمانی که مایکروسافت یک روبات چت به نام Tay را در توئیتر منتشر کرد، مسئله نژاد پرستی در هوش مصنوعی مطرح شد. به تازگی هم در فضای مجازی یک دانشجوی دختر سیاهپوست دانشگاه MIT متوجه میشود برای تشخیص چهره توسط هوش مصنوعی زیادتر از دیگر دوستانش به مشکل میخورد و برای رفع مشکل راههای مختلفی را امتحان میکند تا درنهایت به این نتیجه می رسد که با استفاده از یک ماسک سفید مشکل اش حل میشود! این اتفاق نشان می دهد که متاسفانه نژاد پرستی در هوش مصنوعی هم رسوخ پیدا کرده است. امروز با هم مروری بر چند اپلیکیشن معروف نژاد پرست که باعث خشم بسیاری از مردم شده خواهیم داشت.

فیس اپ

Face App خیلی زود معروف و به عنوان یکی از برنامه های پرطرفدار در جهان معرفی شد اما در کنار موفقیت هایی که داشت، خیلی زود مشکل نژاد پرستانه اش مورد توجه قرار گرفت. حتما شما هم تا به حال با این اپلیکیشن کار کرده اید، همان نرم افزاری که چهره تان را پیر، مدل موی تان را عوض و حتی جنسیت تان را در تصویر تغییر می دهد. اما در کنار همه این فیلترها، فیلتری را برای تغییر چهره در نظر گرفته بود که علامت آتش داشت که به نظر سازندگان این اپ، هدف از آن زیبا تر جلوه دادن چهره ها بود. این فیلتر برای زیبایی بیشتر پوست را روشن می کرد و همین اتفاق باعث شد که مخالفان زیادی پیدا کند و بسیاری بابت این رفتار نژاد پرستانه که چهره تیره پوستان را سفید می کرد خواستار حذف این اپ شدند. البته این اتفاق باعث شد مدیران face app بابت این مسئله عذرخواهی کنند و از کسانی که این مشکل الگوریتمی پنهان در این برنامه را پیدا کردند هم تشکر کنند.

Face App خیلی زود معروف و به عنوان یکی از برنامه های پرطرفدار در جهان معرفی شد اما در کنار موفقیت هایی که داشت، خیلی زود مشکل نژاد پرستانه اش مورد توجه قرار گرفت. حتما شما هم تا به حال با این اپلیکیشن کار کرده اید، همان نرم افزاری که چهره تان را پیر، مدل موی تان را عوض و حتی جنسیت تان را در تصویر تغییر می دهد. اما در کنار همه این فیلترها، فیلتری را برای تغییر چهره در نظر گرفته بود که علامت آتش داشت که به نظر سازندگان این اپ، هدف از آن زیبا تر جلوه دادن چهره ها بود. این فیلتر برای زیبایی بیشتر پوست را روشن می کرد و همین اتفاق باعث شد که مخالفان زیادی پیدا کند و بسیاری بابت این رفتار نژاد پرستانه که چهره تیره پوستان را سفید می کرد خواستار حذف این اپ شدند. البته این اتفاق باعث شد مدیران face app بابت این مسئله عذرخواهی کنند و از کسانی که این مشکل الگوریتمی پنهان در این برنامه را پیدا کردند هم تشکر کنند.

ایمیج نت

یکی دیگر از اپلیکیشن هایی که به خاطر نژادپرستانه بودن جنجال زیادی به پا کرد برنامه ای بود که توسط محققان دانشگاه پرینستون آمریکا توسعه داده شد و در آن تصاویر افراد به شکل توهین آمیز و زشتی برچسب می شد. سازندگان اپ «ImageNet» ادعا می کنند اپ آن ها به کمک هوش مصنوعی ،عکس های سلفی را به طور «صادقانه» دسته بندی می کند. همین مسئله نیز کار دست آن ها داده چون با برچسب گذاری های نژادپرستانه و زشت، توفانی از انتقادات و جنجال را در پی داشته است. اپ مورد بحث، رنگین پوستان را با الفاظ نژادپرستانه و افرادی که از مشکلات جسمی رنج می برند برچسب گذاری کرده است .یک روزنامه نگار سیاه پوست انگلیسی برای امتحان این اپلیکیشن، عکس خود را آپلود کرد و آن را با برچسب «قربانی تجاوز» تحویل گرفت. البته فارغ از جنبه توهین آمیز و نژادپرستانه، این اپ قضاوت های جالبی هم انجام داده؛ مثلاً «دونالد ترامپ» را به عنوان «رئیس جمهور پیشین» برچسب گذاری کرده که به انتخاب نشدن او در دور دوم ریاست جمهوری اشاره می کند.

یکی دیگر از اپلیکیشن هایی که به خاطر نژادپرستانه بودن جنجال زیادی به پا کرد برنامه ای بود که توسط محققان دانشگاه پرینستون آمریکا توسعه داده شد و در آن تصاویر افراد به شکل توهین آمیز و زشتی برچسب می شد. سازندگان اپ «ImageNet» ادعا می کنند اپ آن ها به کمک هوش مصنوعی ،عکس های سلفی را به طور «صادقانه» دسته بندی می کند. همین مسئله نیز کار دست آن ها داده چون با برچسب گذاری های نژادپرستانه و زشت، توفانی از انتقادات و جنجال را در پی داشته است. اپ مورد بحث، رنگین پوستان را با الفاظ نژادپرستانه و افرادی که از مشکلات جسمی رنج می برند برچسب گذاری کرده است .یک روزنامه نگار سیاه پوست انگلیسی برای امتحان این اپلیکیشن، عکس خود را آپلود کرد و آن را با برچسب «قربانی تجاوز» تحویل گرفت. البته فارغ از جنبه توهین آمیز و نژادپرستانه، این اپ قضاوت های جالبی هم انجام داده؛ مثلاً «دونالد ترامپ» را به عنوان «رئیس جمهور پیشین» برچسب گذاری کرده که به انتخاب نشدن او در دور دوم ریاست جمهوری اشاره می کند.

اپ های چهره نگاری

چند ماه پیش تارنمای « aclu» از اشتباهی که باعث شده یک سیاه پوست به اشتباه در زندان بیفتد، پرده برداشت. در گزارش این سایت آمده در اوایل امسال ، پلیس دیترویت «رابرت ویلیامز» مرد سیاه پوست ساکن در حومه این شهر را مقابل چشم همسر و دو دختر کوچکش (دو و پنج ساله) بازداشت کرد. رابرت به مدت 30 ساعت بازداشت بود آن هم به جرم این که نرم افزار تشخیص چهره متعلق به پلیس ایالتی میشیگان به پلیس آگاهی گفته که او از یک ساعت فروشی دزدی کرده است. البته رابرت بعد از گذراندن یک شب در یک سلول تنگ و کثیف وقتی تصویر سارقی را که توسط دوربین ها گرفته شده بود ،دید متوجه شد که به اشتباه دستگیر شده و البته بعد از تحقیق مشخص شد فناوری تشخیص چهره ،دارای نقص فاحش و درباره سیاه پوستان ، مغرضانه است. به همین دلیل بسیاری از از کنگره آمریکا خواسته اند به بازداشت ها بر اساس فناوری چهره نگاری پایان دهد.

چند ماه پیش تارنمای « aclu» از اشتباهی که باعث شده یک سیاه پوست به اشتباه در زندان بیفتد، پرده برداشت. در گزارش این سایت آمده در اوایل امسال ، پلیس دیترویت «رابرت ویلیامز» مرد سیاه پوست ساکن در حومه این شهر را مقابل چشم همسر و دو دختر کوچکش (دو و پنج ساله) بازداشت کرد. رابرت به مدت 30 ساعت بازداشت بود آن هم به جرم این که نرم افزار تشخیص چهره متعلق به پلیس ایالتی میشیگان به پلیس آگاهی گفته که او از یک ساعت فروشی دزدی کرده است. البته رابرت بعد از گذراندن یک شب در یک سلول تنگ و کثیف وقتی تصویر سارقی را که توسط دوربین ها گرفته شده بود ،دید متوجه شد که به اشتباه دستگیر شده و البته بعد از تحقیق مشخص شد فناوری تشخیص چهره ،دارای نقص فاحش و درباره سیاه پوستان ، مغرضانه است. به همین دلیل بسیاری از از کنگره آمریکا خواسته اند به بازداشت ها بر اساس فناوری چهره نگاری پایان دهد.

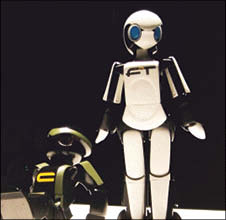

روبات ها قربانی نژادپرستی

نتایج یک پژوهش جدید و جالب نشان می دهد حتی روبات ها نیز قربانی نژادپرستی انسان ها می شوند. این موضوع تا حد زیادی به رنگ و طراحی روبات ها مرتبط است. به گزارش فست کمپانی، یک مطالعه جدید نشان می دهد که احتمال داردانسان ها برای انتخاب روبات نیز بر اساس عقاید نهادینه و تعصبی خود تصمیم بگیرند. درواقع نتایج این مطالعه نشان می دهد هنگامی که از کاربران خواسته می شود روباتی را که تهدید کننده تر به نظر می رسد انتخاب کنند، سریع تر به روبات های سیاه پوست واکنش نشان می دهند. این تحقیق نشان داد که شرکت کنندگان معتقدند یک انسان دورگه یا سیاه پوست و البته یک روبات تیره رنگ سریع تر شلیک خواهد کرد. این نتایج پیامدهای ناگواری برای آینده دارد.

نتایج یک پژوهش جدید و جالب نشان می دهد حتی روبات ها نیز قربانی نژادپرستی انسان ها می شوند. این موضوع تا حد زیادی به رنگ و طراحی روبات ها مرتبط است. به گزارش فست کمپانی، یک مطالعه جدید نشان می دهد که احتمال داردانسان ها برای انتخاب روبات نیز بر اساس عقاید نهادینه و تعصبی خود تصمیم بگیرند. درواقع نتایج این مطالعه نشان می دهد هنگامی که از کاربران خواسته می شود روباتی را که تهدید کننده تر به نظر می رسد انتخاب کنند، سریع تر به روبات های سیاه پوست واکنش نشان می دهند. این تحقیق نشان داد که شرکت کنندگان معتقدند یک انسان دورگه یا سیاه پوست و البته یک روبات تیره رنگ سریع تر شلیک خواهد کرد. این نتایج پیامدهای ناگواری برای آینده دارد.

چرا هوش مصنوعی نژاد پرست شد

به طورقطع، فناوری نژادپرست نیست اما انسان هایی که کدهای نرم افزارها را می نویسند می توانند کدنویسی را به شیوهای متعصبانه و مغرضانه انجام دهند و به نظر می رسد این اتفاق به حدی افتاده که زنگ خطر آن به صدا در آمده است. به همین دلیل آنجلا ویلیامز مدیر سیاست گذاری گوگل در نشستی مجازی اعلام کرد که هوش مصنوعی ممکن است در آینده به جوامع حاشیهای و کم برخوردار در آمریکا آسیب بزند و علت این مسئله آن است که الگوریتمهای هوش مصنوعی بر مبنای دادههای به دست آمده از سفیدپوستان طراحی شده و بخش اعظم مبدعان آن نیز سفیدپوست بودهاند.